robots.txt是一个纯文本文件,是搜索引擎蜘蛛爬行网站的时候要访问的第一个文件,当蜘蛛访问一个站点时,它会首先检查该站点根目录下是否存在robots.txt,如果存在,搜索机器人就会按照该文件中的内容来确定访问的范围,相当于网站与搜索引蜘蛛遵循协议,如果该文件不存在,所有的搜索蜘蛛将能够访问网站上所有没有被屏蔽的网页,作为站长,我们就可以通过robots.txt文件屏蔽掉错误的页面和一些不想让蜘蛛爬取和收录的页面,那么robots.txt该怎么样写呢? robots的语法: 1、User-agent 定义搜索引擎。一般情况下,网站里面都是:User-agent:*,这里*的意思是所有,表示定义所有的搜索引擎。比如,我想定义百度,那么就是User-agent:Baiduspider;定义google,User-agent: Googlebot。 2、Disallow 禁止爬取。如,我想禁止爬取我的admin文件夹,那就是Disallow:/admin/。禁止爬取admin文件夹下的login.html, Disallow: /admin/login.html。 3、Allow允许。我们都知道,在默认情况下,都是允许的。那为什么还要允许这个语法呢?举个例子:我想禁止admin文件夹下的所有文件,除了.html的网页,那怎么写呢?我们知道可以用Disallow一个一个禁止,但那样太费时间很精力了。这时候运用Allow就解决了复杂的问题,就这样写: Allow: /admin/.html$ Disallow: /admin/。 4、$ 结束符。例:Disallow: .php$这句话的意思是,屏蔽所有的以.php结尾的文件,不管前面有多长的URL,如abc/aa/bb//index.php也是屏蔽的。 5、* 通配符符号0或多个任意字符。例:Disallow: *?*这里的意思是屏蔽所有带“?”文件,也是屏蔽所有的动态URL。 robots.txt文件写法举例说明 禁止Google/百度等所有搜索引擎访问整个网站 User-agent: * Disallow: / 允许所有的搜索引擎spider访问整个网站(Disallow:可以用Allow: /替代) User-agent: * Disallow: 禁止Baiduspider访问您的网站,Google等其他搜索引擎不阻止 User-agent: Baiduspider Disallow: / 只允许Google spider: Googlebot访问您的网站,禁止百度等其他搜索引擎 User-agent: Googlebot Disallow: User-agent: * Disallow: / 禁止搜索引擎蜘蛛spider访问指定目录 (spider不访问这几个目录。每个目录要分开声明,不能合在一起) User-agent: * Disallow: /cgi-bin/ Disallow: /admin/ Disallow: /~jjjj/ 禁止搜索引擎spider访问指定目录,但允许访问该指定目录的某个子目录 User-agent: * Allow: /admin/far Disallow: /admin/ 使用通配符星号"*"设置禁止访问的url (禁止所有搜索引擎抓取/cgi-bin/目录下的所有以".html"格式的网页(包含子目录)) User-agent: * Disallow: /cgi-bin/*.html 使用美元符号"$"设置禁止访问某一后缀的文件 (只允许访问以".html"格式的网页文件。) User-agent: * Allow: .html$ Disallow: / 阻止google、百度等所有搜索引擎访问网站中所有带有?的动态网址页面 User-agent: * Disallow: /*?* 阻止Google spider:Googlebot访问网站上某种格式的图片 (禁止访问.jpg 格式的图片) User-agent: Googlebot Disallow: .jpg$ 只允许Google spider:Googlebot抓取网页和.gif格式图片 (Googlebot只能抓取gif格式的图片和网页,其他格式的图片被禁止; 其他搜索引擎未设置) User-agent: Googlebot Allow: .gif$ Disallow: .jpg$ ....... 只禁止Google spider:Googlebot抓取.jpg格式图片 (其他搜索引擎和其他格式图片没有禁止) User-agent: Googlebot Disallow: .jpg$ 声明网站地图sitemap 这个告诉搜索引擎你的sitemap在哪,如: Sitemap: http://www.AAAA.com/sitemap.xml Google和百度对robots.txt文件的介绍: Google robotstxt,百度robots.txt。 PS: 国内的搜索引擎蜘蛛 百度蜘蛛:baiduspider 搜狗蜘蛛:sogou spider 有道蜘蛛:YodaoBot和OutfoxBot 搜搜蜘蛛: Sosospider 国外的搜索引擎蜘蛛 google蜘蛛: googlebot yahoo蜘蛛:Yahoo! Slurp alexa蜘蛛:ia_archiver bing蜘蛛(MSN):msnbot例子:VIP网站模板网建议每一个网站都建一个设置好的robots.txt文件,或者是一个空的robots.txt文件放至网站根目录,robots.txt文件对网站的收录不和排名很重要,也是基于SEO搜索引擎优化要求。

robots.txt是一种存放于网站根目录下的ASCII编码的文本文件,它通常告诉网络搜索引擎的网络蜘蛛,此网站中的哪些内容是不能被搜索引擎的收录的,哪些是可以被收录的。

因为一些系统中的URL是大小写敏感的,所以robots.txt的文件名应统一为小写。robots.txt应放置于网站的根目录下。如果想单独定义搜索引擎的网络蜘蛛访问子目录时的行为,那么可以将自定的设置合并到根目录下的robots.txt。如某站的robots.txt例子:

User-agent: *

Disallow: /admin/

Disallow: /Database/

Disallow: /flash/

Disallow: /Inc/

Disallow: /js/

“User-agent: *”是指可以允许搜索引擎访问;

“Disallow: /admin/ ”是指不允许搜索引擎访问斜杠里的目录admin;

一般的网站,只要按上面的格式来设置就行了,将你不想让搜索引擎收录访问的每个目录都写一行“Disallow:/目录名/”进行配置。

本文地址:http://blog.sina.com.cn/s/blog_5d71453e0100w4ib.html

爱华网本文地址 » http://www.aihuau.com/a/25101017/335393.html

更多阅读

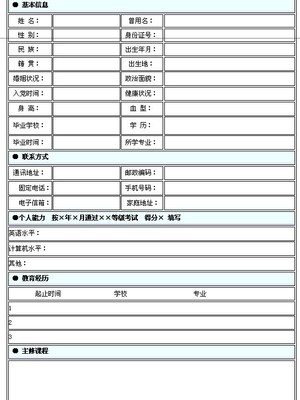

如何填写政治面貌?【详解】——简介政治面貌可不是指的人的外貌,政治面貌其实是一个人的政治身份。对于我们普通公民而言,政治身份似乎没有什么影响,但是对于当权者或者机构组织而言,政治面貌就很重要了,在对个人考察方面或者职位提升方面

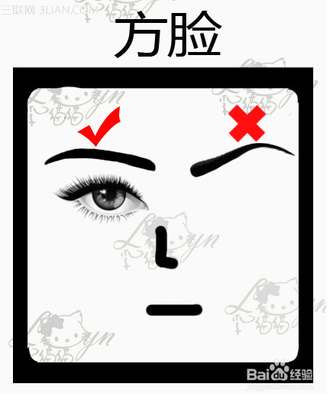

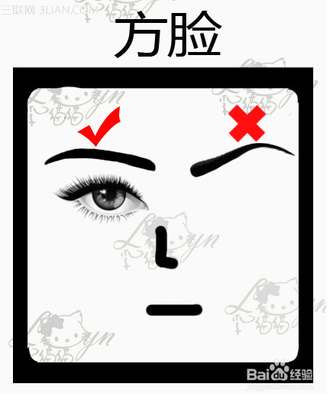

?特写看一下... 对于圆脸型的妹子来说,需要有一些角度的眉毛,把眉峰吊起来,让脸型看起来更有棱角一些~对于下巴比较宽或者太阳穴比较窄的妹纸,美貌的形状要大气自然,而且要适当的短一些,并且加重眉头部分不同脸型适合画眉方法,详解

众所周知,咆哮怒焰系列是威力最大的突击步枪,其高威力以及不俗的精准度让它成为了一把点射神器。而强化系统更是让这把大威力步枪如虎添翼,咆哮怒焰可以算是最值得强化的几把枪支之一了。下面是这把枪的简略评测,以及它的强化详解。大家

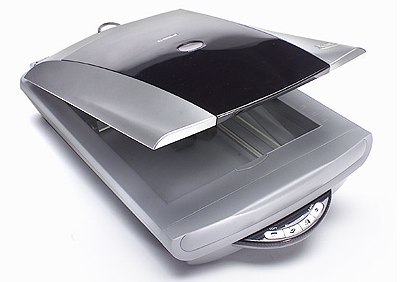

扫描仪怎么用——扫描仪的使用方法详解——简介扫描仪作为日常办公经常用到的工具,下面详解一下具体的使用方法,现在打印机也开始走向家庭了,而现在的打印机有不少都是一体机,有附带扫描以及复印传真等功能,下面一步步跟我来扫描吧。扫

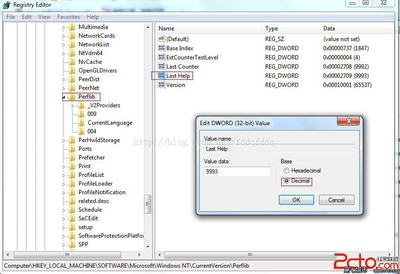

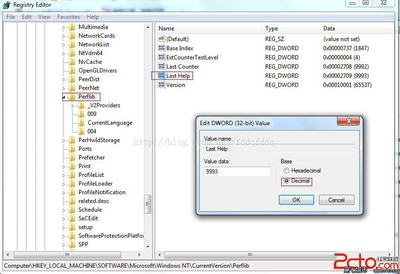

sql server 2008 r2安装详解——简介本篇文章为大家介绍了安装sql server 2008 安装图解,里面有详细步骤,以及需要注意的事项,希望能帮助有需要的朋友。一、进入安装程序插入SQL Server 2008 R2安装光盘,自动运行后出现“SQL Server

爱华网

爱华网