1. 总体回归函数:在给定解释变量Xi条件下被解释变量Yi的期望轨迹称为总

体回归线,或更一般地称为总体回归曲线。相应的函数:E(Y〡Xi) = f(Xi) 称

为(双变量)总体回归函数(population regression function, PRF)

2. 样本回归函数:样本散点图近似于一条直线,画一条直线以尽好地拟合该散

点图,由于样本取自总体,可以该线近似地代表总体回归线。该线称为样本

???回归线。记样本回归线的函数形式为: Yi?f(Xi)??0??1Xi 称为样本回归

函数(sample regression function,SRF)。

3. 随机的总体回归函数:函数 Y=E Y〡X =μ 或者在线性假设下,

Y=??0+??1+μ式称为总体回归函数(方程)PRF的随机设定形式。表明被解释变量除了受解释变量的系统性影响外,还受其他因素的随机性影响。由于方程中引入了随机项,成为计量经济学模型,因此也称为总体回归模型。

4. 线性回归模型:

假设1、回归模型是正确设定的。

假设2、解释变量X是确定性变量,不是随机变量,在重复抽样中取固定值。 假设3、解释变量X在所抽取的样本中具有变异性,而且随着样本容量的无限增加,解释变量X的样本方差趋于一个非零的有限常数,即

(Xi?

i?1n?X)2/n?Q,n?? __

假设4、随机误差项?具有零均值、同方差和不序列相关性:

E(?i)=0 i=1,2, ?,n

Var (?i)=??2 i=1,2, ?,n

Cov(?i, ?j)=0 i≠j i,j= 1,2, ?,n

假设5、随机误差项?与解释变量X之间不相关:

Cov(Xi, ?i)=0 i=1,2, ?,n

假设6、?服从零均值、同方差、零协方差的正态分布

?i~N(0, ??2 ) i=1,2, ?,n

以上假设也称为线性回归模型的经典假设,满足该假设的线性回归模型,也

称为经典线性回归模型

5. 随机误差项(????)和残差项(???? ):(1)?i为观察值Yi围绕它的期望值E(Y|Xi)

的离差,是一个不可观测的随机变量,又称为随机干扰项或随机误差项。

(2)????称为(样本)残差或(剩余)项代表了其他影响???? 的随机因素的集合,可看成是?i的估计量

6. 条件期望:即条件均值,指X取特定值Xi时Y的期望值。

7. 非条件期望:

8. 回归系数或回归参数:在回归方程中表示自变量x 对因变量y 影响大小的

参数。

9. 回归系数的估计量:指用?0,?1等表示的用已知样本提供的信息所估计出来

总体未知参数的结果。

10. 最小平方法:给定一组样本观测值(Xi, Yi)(i=1,2,?n)要求样本回归函

数尽可能好地拟合这组值。普通最小二乘法给出的判断标准是:二者之差的平方和 Q= ????????? 1 ??2??= ?????(??0+??1????) 1 ??2最小

11. 最大似然法:最大或然法,也称最大似然法,是指当从模型总体随机抽取n

组样本观测值后,最合理的参数估计量应该使得从模型中抽取该n组样本观测值的概率最大。

12. 估计量的标准差:度量一个变量变化大小的测量值。 TSS??yi2??(Yi?)2

13. 总离差平方和:记为总离差平方和(TSS):说明实际的Y

值围绕其均值的总

ESS??yi?2??(Yi?)?2

变异。

14. 回归平方和:记 为回归平方和,反映由模型中解释

变量所解释的那部分离差的大小。

RSS??ei??(Yi?Y?i)15. 残差平方和:记 为残差平方和,反映样本观测值与22

估计值偏离的大小,也是模型中解释变量未解释的那部分离差的大小。

16. 协方差:期望值分别为E(X) = μ 与 E(Y) = ν 的两个实数,随机变量X

与Y之间的协方差定义为:COV(X,Y)=E[(X-E(X))(Y-E(Y))] ,用来度量X,Y两个变量关联程度的统计量

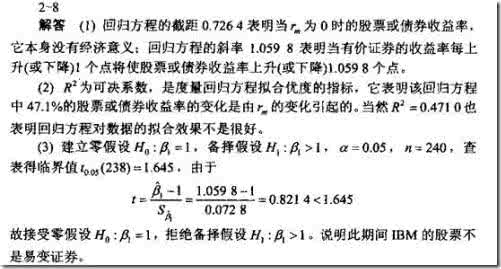

17. 拟合优度检验:拟合优度检验是指对样本回归线与样本观测值之间拟合程度

的检验。度量拟合程度的指标是可决系数R2。

18. t检验:t检验是针对每个解释变量进行的显著性检验,即构造一个t统计

量,如果该统计量的值落在置信区间外,就拒绝原假设。

19. F检验: 两个独立的卡方变量之商的分布(注意自由度)

20. 异方差性:对于不同的样本点,随机干扰项的方差不再是常数,而是互不相

同,则认为出现了异方差性。

21. 序列相关性:多元线形回归模型的基本假设之一是模型的随机干扰项相互独

立或不相关。如果模型的随机干扰项违背了相互独立的基本假设,称为存在序列相关性。

22. 多重共线性:如果某两个或多个解释变量之间出现了相关性,则称为多重共

线性

23. 偏回归系数:在多元回归模型中,每一个解释变量前的参数即为偏回归系数,

它测度了当其他解释变量保持不变时,该变量增加1个单位对解释变量带来的平均影响程度。

24. 完全多重共线性:如果存在

c1X1i+c2X2i+?+ckXki=0 i=1,2,?,n

其中: ci不全为0,则称为解释变量间存在完全共线性。

25. 不完全多重共线性:如果存在

c1X1i+c2X2i+?+ckXki+vi=0 i=1,2,?,n

其中ci不全为0,vi为随机误差项,则称为 近似共线性或交互相关。

26. 随机解释变量:如果存在一个或多个随机变量作为解释变量,则称原模型出现随机解释变量问题。??

27. 差分法:差分法是将原模型变换为满足OLS法的差分模型,再进行OLS估计。

28. 广义最小二乘法(GLS) :是一种常见的消除异方差的方法.它的主要思想是为解释变量加上一个权重,从而使得加上权重后的回归方程方差是相同的.因此在GLS方法下我们可以得到估计量的无偏和一致估计,并可以对其进行OLS下的t检验和F检验.

29. D.W.检验:简述D.W.检验的步骤:

(1)计算DW值;

(2)给定a,由n和k的大小查DW分布表,得临界值dL和dU

(3)比较、判断。若0<D.W.<dL,存在正自相关;dL<D.W.<dU,不能确定;dU <D.W.<4-dU,无自相关;4-dU <D.W.<4-dL,不能确定;4-dL <D.W.<4 ,存在负自相关。

当D.W.值在2左右时,模型不存在一阶自相关。

30. 多元线性回归:在现实经济活动中往往存在一个变量受到其他多个变量的影响的现象,表现为在线性回归模型中有多个解释变量,这样的模型成为多元线性回归模型,多元指多个变量。

31. 正规方程组:指采用OLS法估计线性回归模型时,对残差平方和关于各参数求偏导,并令偏导数为0后得到的一组方程:

爱华网www.aIhUaU.com网友整理上传,为您提供最全的知识大全,期待您的分享,转载请注明出处。 爱华网

爱华网